728x90

반응형

문제

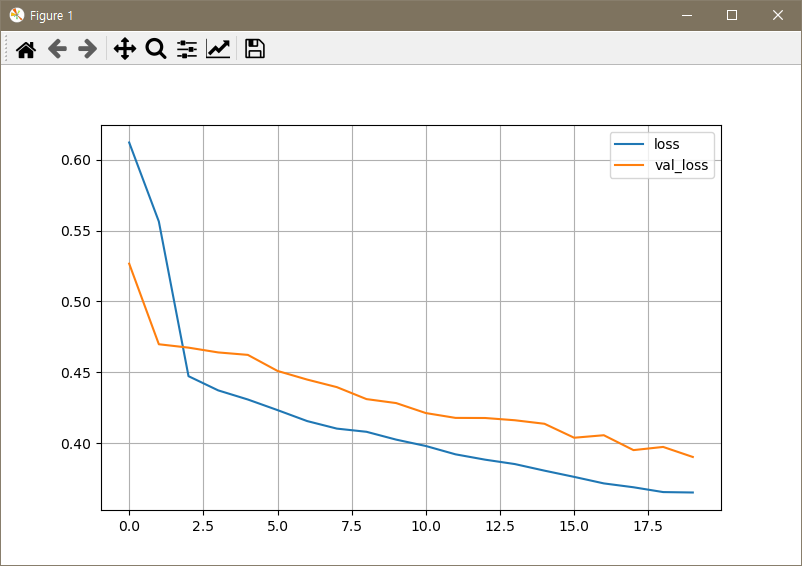

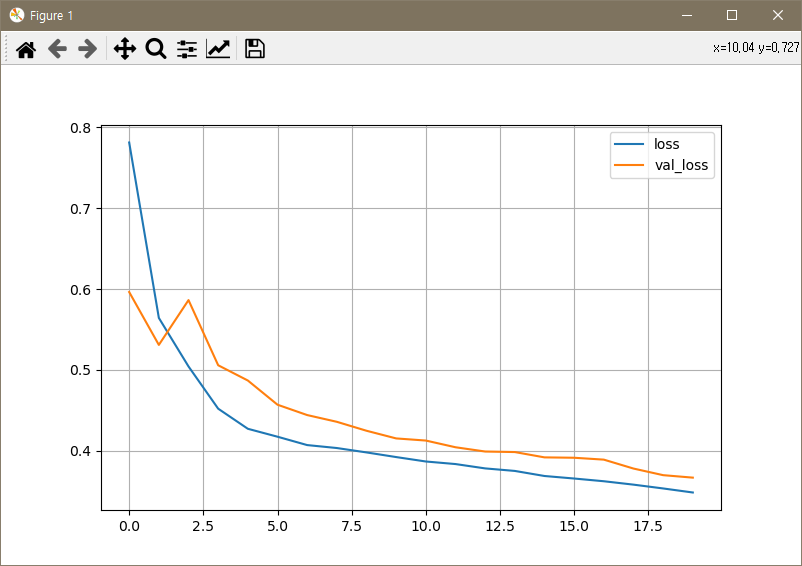

WideDeep 신경망이 제대로 train되지 않는 현상

원인

연결층에 연결된 두 층은 아래와 같다.

1. input - dense(30) - dense(30)

2. input

추정 원인 1: 전처리 되지 않은 input layer 값을 그대로 연결층에 연결.

-> use batch normalization

추정 원인 2: 연결층에 포함된 음수 값.

-> use activation function

4가지 방식으로 실험

1. input - bn

2. input - af(sigmoid / relu)

3. input - bn - af

4. input - af - bn

Input - activation function (relu)에서만 문제가 발생한 것을 보아

WideDeep 신경망이 제대로 train되지 않는 현상의 원인은 Input 값이 표준화되지 않아 생기는 문제라고 생각할 수 있다.

해결

input 값을 정규화

e.g) batch normalization

728x90

반응형

'배움 - 차근차근 기록하자 > [개발] 딥러닝 🍩' 카테고리의 다른 글

| 가우시안 분포 (0) | 2024.06.14 |

|---|---|

| 제곱합오류함수(SSE) 미분 식 (1) | 2024.06.14 |

| [딥러닝] top layer는 입력층일까 출력층일까? (0) | 2022.04.13 |

| [GauGan2] AI가 자동으로 그림을 그려준다고? 나도 간단하게 해보기 (0) | 2022.01.02 |